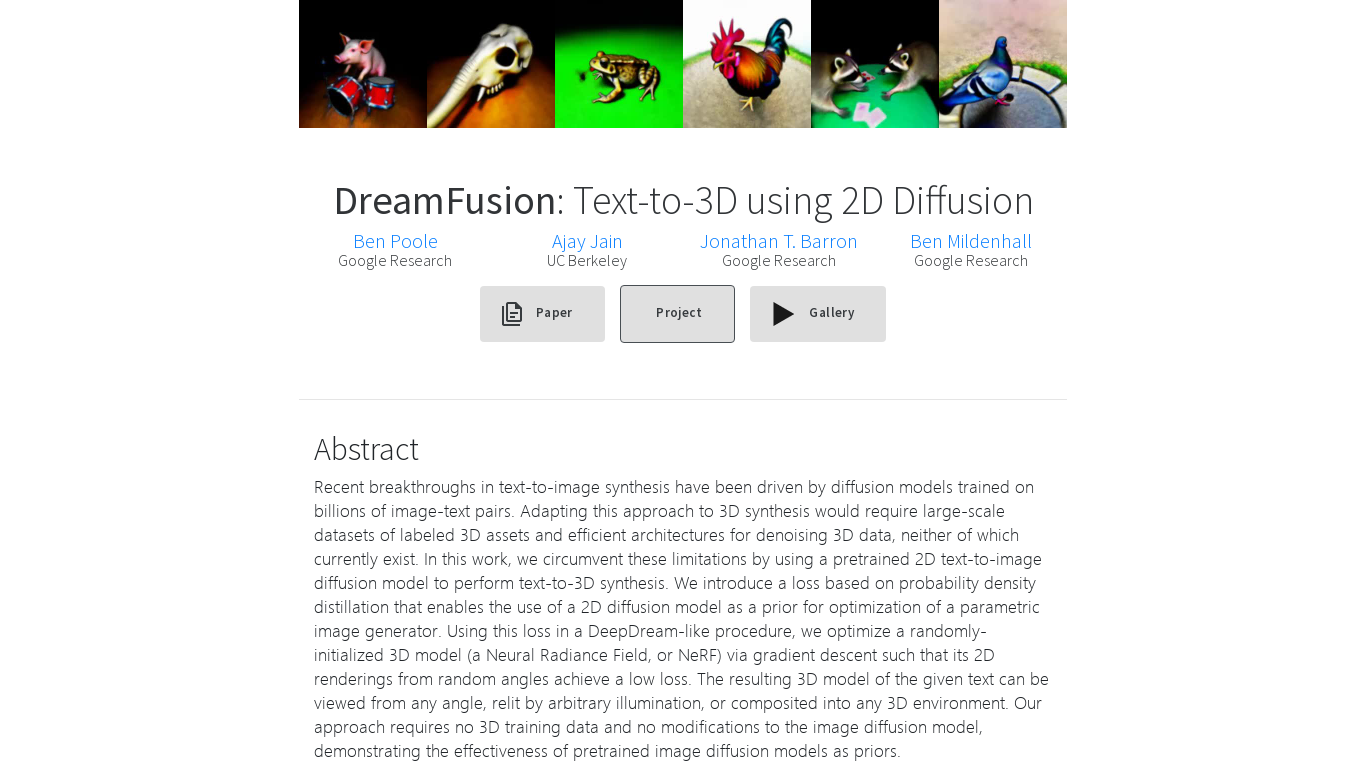

在数十亿图像文本对上训练的扩散模型推动了文本到图像合成的最新突破。将这种方法应用于 3D 合成将需要标记 3D 资产的大规模数据集和用于去噪 3D 数据的高效架构,而这两者目前都不存在。在这项工作中,我们通过使用预训练的 2D 文本到图像扩散模型来执行文本到 3D 合成来规避这些限制。我们引入了一种基于概率密度蒸馏的损失,它可以使用 2D 扩散模型作为参数图像生成器优化的先验。在类似 DeepDream 的过程中使用这种损失,我们通过梯度下降优化随机初始化的 3D 模型(神经辐射场或 NeRF),使其从随机角度的 2D 渲染实现低损失。给定文本的生成的 3D 模型可以从任何角度查看,通过任意照明重新点亮,或合成到任何 3D 环境中。我们的方法不需要 3D 训练数据,也不需要修改图像扩散模型,证明了预训练图像扩散模型作为先验模型的有效性。